计算机数据处理的理论基础与技术架构

计算机数据处理作为计算机科学的核心领域,涉及信息的输入、存储、处理与输出等全过程,其背后依托着严密的理论基础与多层次的技术架构。从理论层面看,数据处理的本质是将现实世界的信息抽象为可计算的模型,并通过算法与数据结构进行高效操作。

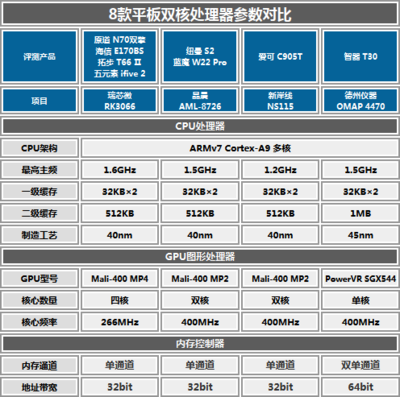

计算机数据处理的基石是二进制系统与布尔逻辑。所有数据,无论是数字、文本、图像还是声音,最终都被编码为0和1的序列。布尔代数则为逻辑运算提供了数学基础,使得计算机能够执行与、或、非等基本操作,进而实现复杂的决策与控制流程。冯·诺依曼体系结构确立了程序存储与顺序执行的原则,奠定了现代计算机处理数据的基本模式,即通过中央处理器(CPU)从存储器中读取指令与数据,经运算后写回结果。

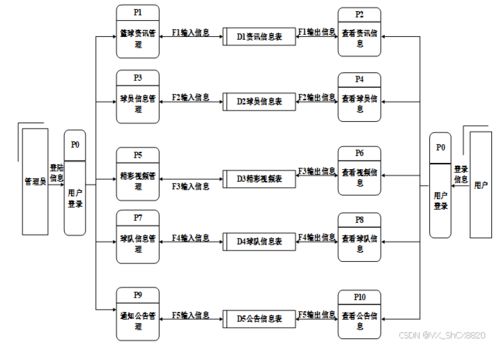

算法与数据结构理论是高效数据处理的关键。算法定义了解决问题的步骤与规则,其时间复杂度和空间复杂度直接决定了处理效率。例如,排序算法中的快速排序与归并排序,通过分治策略将大规模数据问题分解为小规模子问题,显著提升了处理速度。数据结构如数组、链表、树、图等,则提供了组织与存储数据的框架,使得数据的插入、删除、查找等操作能够优化。数据库理论进一步扩展了这一领域,通过关系模型与SQL语言,实现了对结构化数据的高效管理与查询。

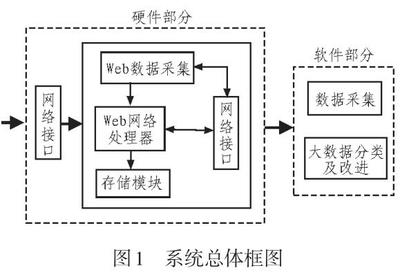

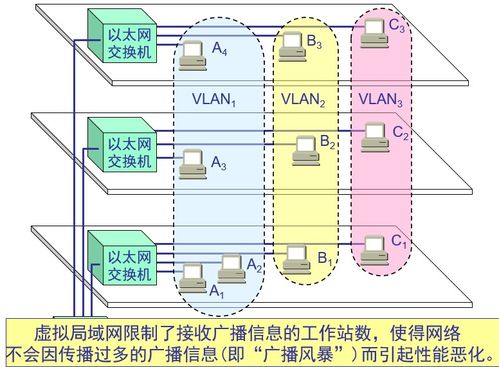

计算机数据处理依赖多层次的技术架构。从硬件层面,CPU、内存、硬盘及各种输入输出设备协同工作,确保数据流动的顺畅。操作系统作为软件与硬件的桥梁,通过进程管理、内存分配和文件系统,为数据处理提供稳定的运行环境。在软件层面,编程语言如Python、Java等提供了表达算法的工具,而编译器与解释器则将高级语言转换为机器可执行的指令。分布式计算与云计算技术兴起,使得数据处理能够跨越多个节点,处理海量数据集,例如MapReduce框架通过并行化大幅提升了大数据处理能力。

数据处理的理论不断演进,以应对新兴挑战。随着人工智能的发展,机器学习算法通过训练模型从数据中自动提取模式,推动了智能数据处理的应用。量子计算理论探索利用量子比特进行并行计算,有望在未来突破传统计算机的数据处理极限。在安全领域,密码学理论确保数据在传输与存储过程中的机密性与完整性,如非对称加密算法依赖大数分解的复杂性来保护信息。

总而言之,计算机数据处理是一个融合数学、工程与技术的综合性领域,其理论不仅解释了数据如何被表示与操作,还指导着实践中的系统设计与优化。从基础二进制到前沿人工智能,理论创新持续驱动技术进步,使计算机能够更快速、更智能地处理日益增长的数据,支撑起现代社会的数字化进程。

如若转载,请注明出处:http://www.yimai520.com/product/22.html

更新时间:2026-05-20 01:25:44